- 사전 학습된 머신 러닝 모델을 엣지 추론 노드에 분산 배포

- 180개 이상의 엣지 노드로 구성된 지코어 글로벌 네트워크 통해 최종 사용자와 가장 가까운 곳에서 실행

- AI 추론에 특화된 엔비디아 L40S GPU에서 실행…. 30밀리초 미만의 응답시간 보장

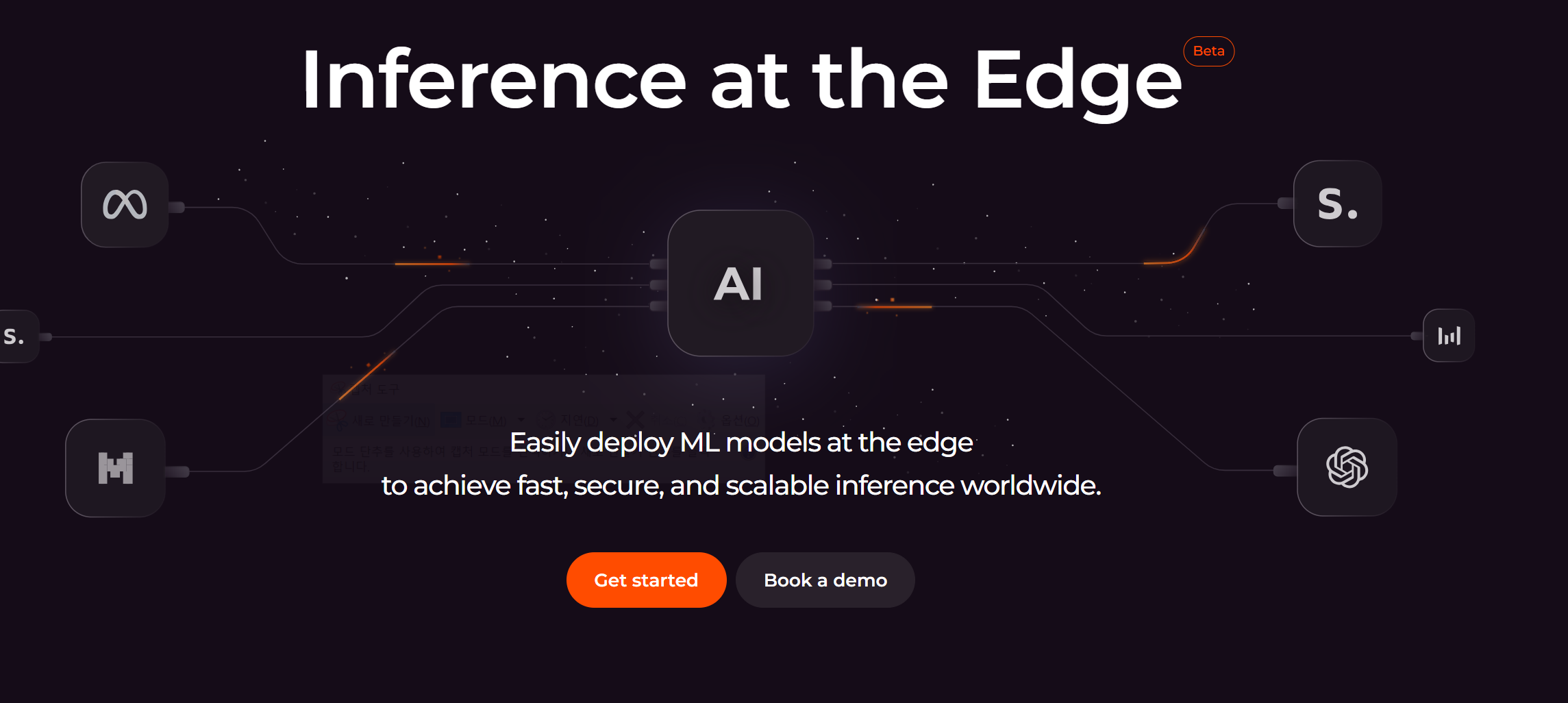

지코어(Gcore)는 AI 애플리케이션에 초저지연 경험을 실시간 제공하는 ‘인퍼런스 앳더 엣지(Inference at the Edge)’ 솔루션을 출시한다고 10일 밝혔다. 이 혁신적인 솔루션은 사전 학습된 머신 러닝 모델을 전 세계에 분포돼 있는 엣지 추론 노드 중 사용자와 가장 가까운 경로 또는 위치에서 응답할 수 있도록 함으로써 원활한 실시간 추론을 보장한다.

지코어 인퍼런스 앳더 엣지는 180개 이상의 엣지 노드로 구성된 지코어의 광범위한 글로벌 네트워크(PoP)에서 실행되며, 모두 지코어의 정교한 저지연 스마트 라우팅 기술로 상호 연결된다. 고성능의 각 노드는 지코어 네트워크 중 최종 사용자와 가까운 엣지에 전략적으로 배치된다.

무엇보다 지코어 각 엣지에서의 AI 추론은, 이를 위해 특별히 설계된 업계 내 최고의 칩인 엔비디아(NVIDIA) L40S GPU에서 실행된다. 사용자가 요청을 보내면 엣지 노드는 지연 시간이 가장 짧은, 가장 가까운 엣지 추론 노드로 경로를 설정하여 일반적으로 30ms 미만의 응답 시간을 보장한다. 네트워크 간 최대 대역폭도 200Tbps로 최고 수준의 학습 및 추론 능력이 가능하다.

또한, 인퍼런스 앳더 엣지는 광범위한 기본 머신 러닝 및 커스텀 모델을 지원한다. 지코어 머신 러닝 모델 허브에서 사용 가능한 오픈 소스 기반 모델로는 LLaMA Pro 8B, Mistral 7B, Stable-Diffusion XL 등이 있다. 여러 형식 또는 여러 소스로부터 데이터를 수신해, 모델을 사용 사례에 맞게 선택하고 학습한 후 전 세계에 위치하고 있는 인퍼런스 앳더 엣지 노드에 배포할 수 있다. 이는 일반적으로 개발팀이 직면하는 중요한 문제 중 하나인, 이미 AI 모델이 학습된 동일한 서버에서 다시 실행됨으로써 발생하는 성능이 저하되는 문제를 해결해 준다.

지코어 인퍼런스 앳더 엣지의 주요 이점에는 ▲유연한 가격구조로 고객이 사용한 리소스에 대해서만 비용을 지불할 수 있어 ‘비용 효율적인 배포’가 가능 ▲디도스 공격에도 머신 러닝의 각 앤드포인트가 지코어의 인프라를 통해 자동으로 보호되는 내장형 디도스 보호 기능 ▲GDPR, PCI DSS, ISO/IEC 27001 등 업계 표준을 준수하는 뛰어난 데이터 프라이버시 및 보안을 보장 ▲모델 자동확장 기능으로 모델이 항상 최대 수요는 물론 예기치 않은 로드 급증을 지원 ▲ 빠르게 진화하는 요구에 맞춰 S3 호환 클라우드 오브젝트 스토리지를 무제한 제공등이 있다.

이러한 강점을 통해 지코어 인퍼런스 앳더 엣지는 자동차, 제조업, 유통, 테크놀로지 등 다양한 산업 분야의 기업들이 비용 효율적이고 확장 가능하며, 안전한 AI 모델 배포를 통해 역량을 강화할 수 있도록 지원한다. 이를 통해 기업은 생성형 AI, 객체 인식, 실시간 행동 분석, 가상 비서, 생산 모니터링과 같은 사용 사례를 글로벌 규모로 빠르게 실현할 수 있다.

지코어 안드레 레이텐바흐 CEO는 "지코어 인퍼런스 앳더 엣지는 고객이 전 세계에 AI 애플리케이션을 배포하는 데 필요한 비용과 기술, 인프라에 대해 걱정할 필요 없이 머신 러닝 모델을 학습시키는 데 집중할 수 있도록 지원한다”고 설명하고, “지코어는 엣지가 최고의 성능과 최종 사용자 경험을 제공하는 곳이라고 믿으며, 모든 고객이 탁월한 규모와 성능을 누릴 수 있도록 지속적으로 혁신해 나가고 있다”고 밝혔다.

또한, “인퍼런스 앳더 엣지는 전 산업 분야에 걸쳐 현대적이고 효과적이며, 가장 효율적인 AI 추론 환경을 제공하게 될 것"이라고 강조했다.

#지코어#AI#인퍼런스#엣지#머신러닝#추론#엔비디아#