- 워크스테이션·엣지·데이터센터·AI 팩토리로 이어지는 추론 중심 인프라 구성

레노버가 GTC 2026에서 AI 추론부터 AI 팩토리까지 이어지는 하이브리드 AI 실행 구조를 공개했다. 온프레미스와 클라우드를 결합해 추론 워크로드를 분산 처리하고 토큰 처리 효율과 비용 기준으로 인프라 설계를 재편했으며, 유사 IaaS 대비 최대 6개월 빠른 투자 회수와 최대 8배 낮은 토큰 비용을 제시했다.

추론 중심으로 이동한 인프라 설계 기준

AI 활용 축이 학습 중심에서 실시간 추론 중심으로 이동하면서 인프라 설계 기준도 연산 성능에서 비용과 처리량으로 이동했다. 레노버는 ‘하이브리드 AI 어드밴티지’를 통해 추론 워크로드를 온프레미스와 클라우드에 나눠 배치하고 데이터 위치에 따라 실행 경로를 구분했다. 민감 데이터는 로컬에서 처리하고 대규모 연산은 데이터센터로 전달해 데이터 이동을 줄이고 응답 시간을 단축했다.

워크스테이션에서 시작되는 추론 실행 계층

RTX 블랙웰 기반 워크스테이션과 AI 개발자 디바이스는 최대 2,000억 파라미터 모델을 지원하고 로컬 환경에서 초기 추론을 수행한다. 생성된 중간 결과는 엣지 또는 데이터센터로 전달되고 추가 연산과 응답 생성으로 이어진다. 개발 단계에서 구성된 모델과 실행 환경을 그대로 운영 단계로 연결해 배포 과정 없이 실행 흐름을 유지한다.

엣지와 데이터센터로 이어지는 처리 구조

씽크엣지와 씽크시스템 서버는 엔비디아 AI 엔터프라이즈와 결합해 멀티모달 추론과 생성형 AI 워크로드를 동시에 처리한다. 레노버는 단일 노드부터 클러스터까지 확장 가능한 인프라를 구성하고 데이터 수집, 전처리, 추론, 결과 반환으로 이어지는 처리 경로를 하나로 연결했다. 비전 AI와 생성형 AI를 동일 인프라에서 병렬로 실행하고 결과를 서비스 시스템으로 직접 전달한다.

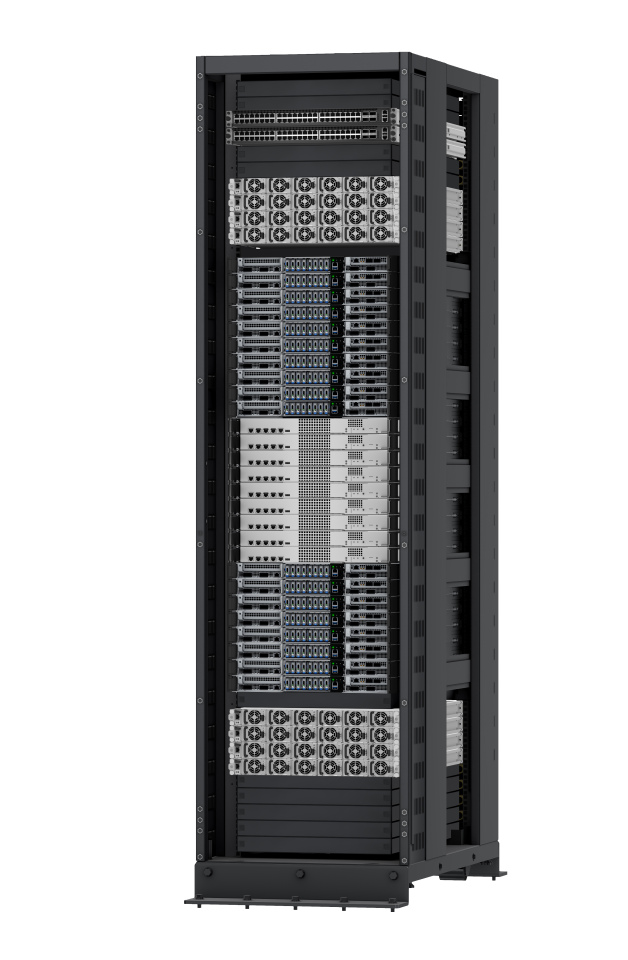

AI 팩토리로 확장되는 데이터센터 인프라

레노버는 엔비디아 기반 AI 시스템을 통해 수랭식 랙 단위 인프라와 가속 컴퓨팅을 결합한 AI 팩토리 구조를 구성했다. 다수의 GPU 노드를 묶어 대규모 추론 요청을 병렬 처리하고 전력과 냉각을 포함한 데이터센터 단위 운영 환경을 구축했다. 단일 서버에서 랙 단위로 확장해 처리량을 높이고 토큰 단가를 낮췄다.

산업별 적용으로 이어지는 실행 흐름

유통, 제조, 헬스케어, 스포츠 환경에서는 데이터 수집부터 분석, 추론, 실행까지 이어지는 파이프라인을 구성했다. 영상과 센서 데이터를 입력으로 받아 엣지에서 1차 분석을 수행하고 데이터센터에서 추가 추론을 처리한 뒤 결과를 운영 시스템으로 전달한다. 콘텐츠 생성과 운영 자동화는 동일한 처리 흐름에 포함해 서비스 실행까지 이어진다. 데이터 입력부터 실행까지 하나의 운영 체계로 연결된 구조다.

파트너 생태계 기반 운영 확장 구조

레노버는 엔비디아를 중심으로 IBM, 뉴타닉스, 클라우디안과 협력해 데이터 관리, 가상화, 스토리지 계층을 통합한 운영 체계를 구성했다. 각 파트너 기술은 데이터 흐름에 맞춰 배치하고 하이브리드 환경에서도 동일한 추론 실행 구조로 연결한다. 파일럿 단계에서 운영 환경으로 전환하는 시간을 줄이는 방식이다.

#레노버 #엔비디아 #GTC2026 #AI추론 #AI팩토리 #하이브리드AI #데이터센터 #AI인프라