- 에이전틱 AI 대응, 랙당 성능 2배 구조 제시

ARM이 에이전틱 AI 데이터센터 대응을 위한 ‘ARM AGI CPU’를 공개하며 IP 중심 구조에서 자체 설계 실리콘까지 컴퓨팅 플랫폼 범위를 확장했다.

AI 시스템이 학습 중심에서 추론·계획·실행이 반복되는 에이전트 구조로 이동하면서 데이터 이동과 작업 조율을 담당하는 CPU 수요가 증가하고 있다. 토큰 처리량 증가와 멀티 에이전트 워크로드 확산으로 동일 전력 범위 내 더 높은 처리 밀도가 요구되며 데이터센터는 기존 대비 더 많은 CPU 자원을 필요로 하는 구조로 전환되고 있다.

에이전틱 AI 확산, CPU 수요 증가

AI 에이전트는 추론뿐 아니라 계획과 작업 실행을 반복 수행하며 지속적으로 데이터를 교환하는 구조로 작동한다. 이 과정에서 CPU는 가속기 간 작업 순서를 제어하고 메모리 접근을 관리하는 컨트롤 플레인 역할을 담당한다. ARM은 에이전틱 데이터센터 환경에서 워크로드 흐름을 안정적으로 유지할 수 있도록 CPU 구조를 설계했다.

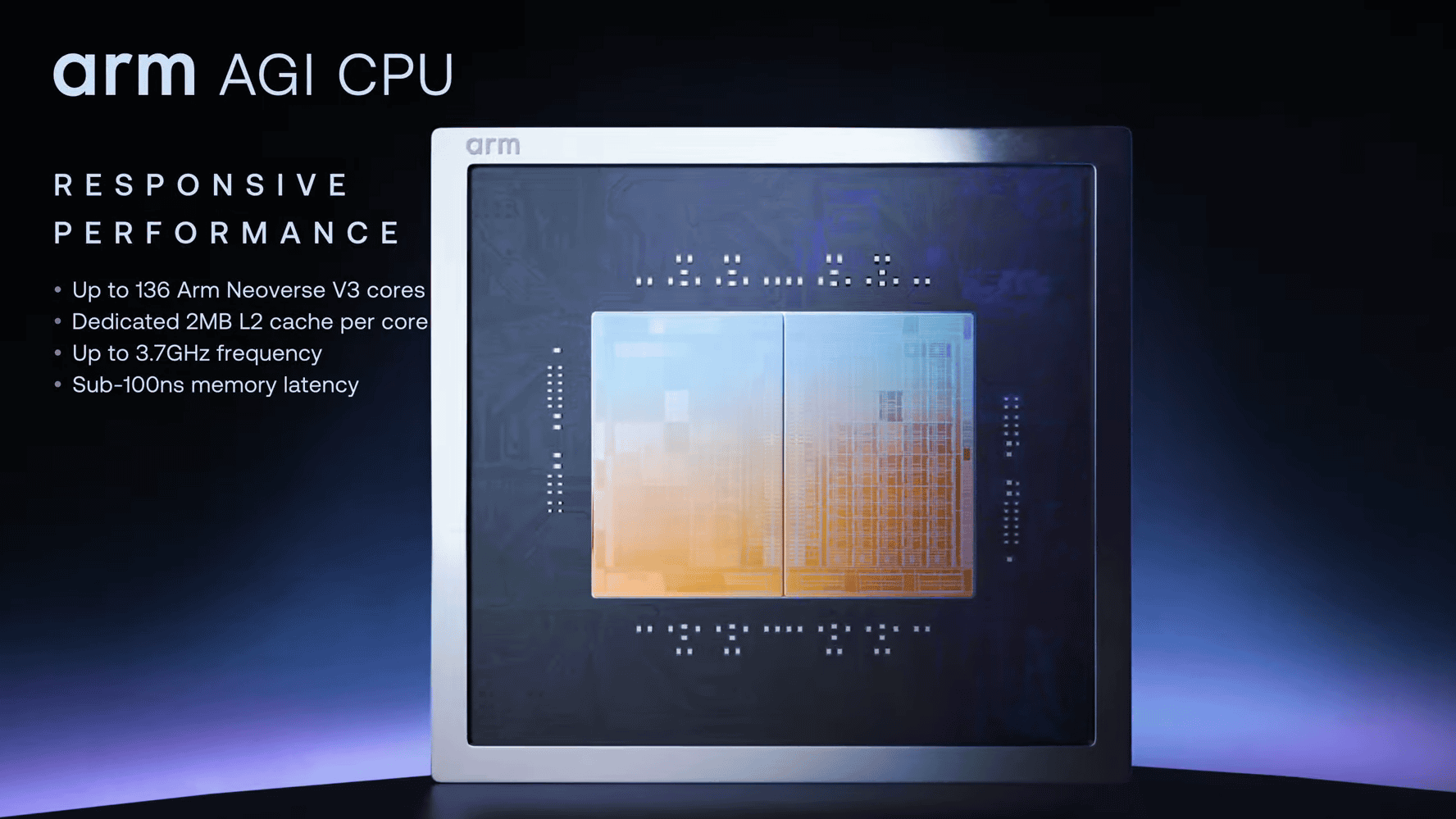

ARM AGI CPU는 최대 136개 Arm Neoverse V3 코어를 기반으로 구성되며 코어당 6GB/s 메모리 대역폭과 100ns 미만 지연시간 구조를 제공한다. 고밀도 1U 서버 기준 랙당 최대 8,160개의 코어를 구성할 수 있으며 수랭식 환경에서는 4만5천개 이상의 코어 확장을 지원한다. 이러한 설계는 가속기 활용률을 높이고 동일 전력 범위 내 처리 성능 밀도를 높이는 방향으로 작동한다.

IP부터 실리콘까지 플랫폼 확장

ARM은 기존 IP 라이선스와 컴퓨팅 서브시스템(CSS)에 더해 자체 설계한 양산형 실리콘을 제공하며 플랫폼 전략 범위를 확대했다. 파트너는 Arm IP, CSS, Arm 설계 실리콘 중 필요한 계층을 선택해 인프라를 구축할 수 있으며 설계 유연성을 확보할 수 있다. 이러한 구조는 AI 데이터센터 구축 속도를 높이고 플랫폼 선택 폭을 확장하는 방향으로 작용한다.

ARM AGI CPU는 x86 기반 서버 대비 랙당 2배 이상의 성능을 제공한다. 동일 전력 범위에서 더 많은 연산을 처리하도록 설계했으며 1GW 규모 AI 데이터센터 기준 최대 100억 달러 수준의 자본지출(CAPEX) 절감 효과가 예상된다.

메타 공동 개발, 에코시스템 확대

메타는 ARM과 공동으로 AGI CPU 개발에 참여하고 MTIA(Meta Training and Inference Accelerator)와 결합해 대규모 AI 시스템의 워크로드 오케스트레이션 구조를 최적화하고 있다. 클라우드플레어, SAP, SK텔레콤 등 주요 기업도 가속기 관리와 API 처리, 애플리케이션 호스팅 영역에서 해당 CPU 활용을 검토하고 있다.

ARM은 레노버, 슈퍼마이크로, 콴타 등 ODM과 협력해 초기 시스템을 공급하고 있으며 올해 하반기부터 적용 범위를 확대할 계획이다. AWS, 구글, 마이크로소프트, 엔비디아, 삼성, SK하이닉스, TSMC 등 50개 이상의 기업이 Arm 기반 실리콘 확장을 지원하는 에코시스템에 참여하고 있다.

ARM은 이번 AGI CPU를 통해 가속기 중심 연산 구조에서 CPU 기반 오케스트레이션 계층 중심 구조로 이동하는 흐름에 대응한다는 전략이다.

#ARM #AGICPU #NeoverseV3 #에이전틱AI #데이터센터CPU #AI인프라 #멀티에이전트 #반도체