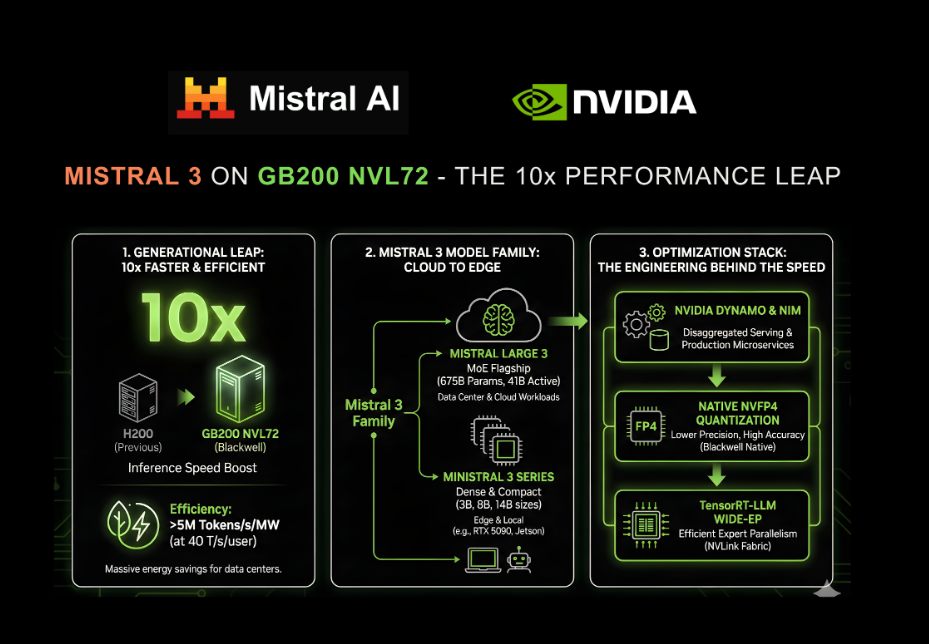

- 프론티어급 ‘미스트랄 라지 3’, GB200 NVL72에서 H200 대비 10배 성능 향상

엔비디아가 미스트랄 AI와 협력해 대규모 MoE 아키텍처 기반의 차세대 오픈 모델 제품군 ‘미스트랄 3’를 공개했다고 밝혔다. 이번 협력은 클라우드부터 엣지까지 전 구간에서 고성능·고효율 AI 모델을 구현하기 위한 기술 최적화를 중심으로 이뤄졌다.

‘미스트랄 라지 3’, 대규모 MoE 아키텍처 기반 성능 확장

미스트랄 3 제품군은 프론티어급 모델 ‘미스트랄 라지 3’와 경량 제품군 ‘미니스트랄 3’로 구성된다. 특히 미스트랄 라지 3는 410억 개의 활성 매개변수와 총 6,750억 개의 파라미터, 25만 6천 개의 대용량 컨텍스트 윈도우를 갖춘 대규모 MoE 아키텍처로 설계돼 확장성과 효율성을 동시에 제공한다.

모든 토큰을 전체 뉴런으로 처리하는 기존 방식 대신 필요한 전문가만 활성화하는 구조를 통해 연산 낭비를 줄이고, 다양한 엔터프라이즈 워크로드에서 정확도·처리량을 극대화한다.

엔비디아 GB200 NVL72 시스템과 결합된 미스트랄 라지 3는 이전 세대 H200 대비 10배의 성능 향상을 달성했다. 이는 병렬 처리 효율과 NV링크 기반 일관된 메모리 도메인이 결합된 결과로, 엔터프라이즈 AI 모델 배포에 필요한 처리 속도·비용 효율·전력 효율을 크게 끌어올린다.

엣지까지 확장된 ‘미니스트랄 3’… 라마.cpp·올라마와 연동

미니스트랄 3는 총 9종의 경량 모델로 구성되며, 엔비디아 스파크, RTX 기반 PC·노트북, 젯슨 디바이스 등 엣지 플랫폼 전반에 최적화됐다. 엔비디아는 라마.cpp와 올라마와 협력해 GPU 최적화 성능을 극대화해, 개발자가 엣지 환경에서도 빠르고 효율적인 AI 모델 실행이 가능하도록 지원한다. 개발자와 AI 연구자는 이를 통해 로컬 환경에서 경량 모델을 즉시 테스트하고 맞춤 구성할 수 있으며, 실시간 추론·경량 에이전트 구축 등 다양한 활용이 가능하다.

오픈소스 기반 확장성 강화… 연구·산업 전반 실사용 확대

미스트랄 3 모델 제품군은 오픈 라이선스로 제공되어 누구나 자유롭게 실험·활용·맞춤화할 수 있다. 엔비디아는 미스트랄 모델을 데이터 디자이너, 커스터마이저, 가드레일, 네모 에이전트 툴킷 등 AI 에이전트 개발을 위한 네모 생태계와 연동해, 프로토타입부터 제품화까지 이어지는 전 과정을 가속한다.

또한 텐서RT-LLM, SGLang, vLLM 등 주요 추론 프레임워크가 미스트랄 3에 맞춰 최적화되면서, 고성능 분산 추론·저정밀도 NVFP4 연산·대규모 병렬 처리 등에서 성능 향상이 이루어졌다.

클라우드·데이터센터·엣지 전반에서 활용 확대

미스트랄 3는 주요 오픈소스 플랫폼과 글로벌 클라우드 서비스에서 이미 제공되고 있으며, 곧 엔비디아 NIM 마이크로서비스 형태로도 배포될 예정이다. 기업은 이를 활용해 자체 데이터·도메인 요구에 맞춘 모델 운영을 빠르게 구성할 수 있다.

#엔비디아 #미스트랄AI #Mistral3 #Large3 #Ministral3 #NVL72 #AI모델 #MoE #엣지AI #오픈모델 #엔터프라이즈AI

티티테크오토, 아시아 OEM과 MotionWise 협력 강화…SDV 안전 아키...

티티테크오토, 아시아 OEM과 MotionWise 협력 강화…SDV 안전 아키...

크리테오 코리아, ‘에이전시 어워즈 2025’ 개최… 파트너사 성과 조명

크리테오 코리아, ‘에이전시 어워즈 2025’ 개최… 파트너사 성과 조명